AI界掌管开源的神——DeepSeek回来了!

刚刚,DeepSeek开源了全新的数学模型DeepSeekMath-V2,专注于可自验证的数学推理。

DeepSeekMath-V2不仅在IMO 2025和CMO 2024中取得金牌级分数,而且还在Putnam 2024中,得分118/120,超过了人类最高分90。

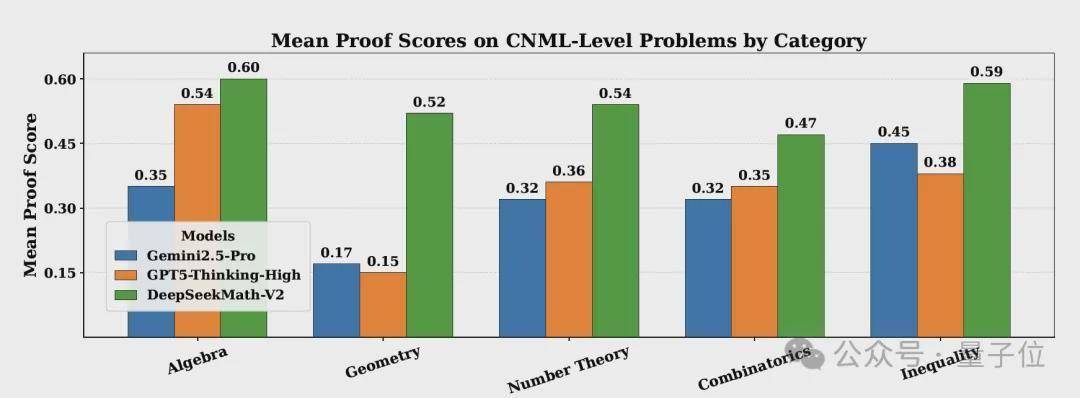

与此同时,DeepSeekMath-V2在所有CNML级别问题类别(代数、几何、数论、组合学、不等式)上均优于GPT-5-Thinking-High和Gemini 2.5-Pro。

不仅性能无敌,网友表示这还是第一个开源的IMO金牌模型。

这下,谷歌和OpenAI要坐不住了!

特别是OpenAI,本来就打算放出IMO金牌模型来应对谷歌Gemini 3 Pro的冲击,现在被DeepSeek抢先一步。

(鲸鱼回来了!)

值得一提是,这篇论文的一作邵智宏也是之前DeepSeekMath 7B的一作,在那篇论文中,他们提出了著名的GRPO

最强开源IMO金牌模型

总的来说,DeepSeekMath-V2是一个旨在实现自验证数学推理(Self-verification)的大型语言模型(685B)。

它的核心在于开发和利用强大的证明验证能力来指导和优化证明生成,从而克服传统上依赖最终答案作为奖励的强化学习(RL)方法的局限性。

传统用于数学推理的强化学习(RL)方法存在根本性限制:

最终答案奖励的不可靠性:将LLM奖励基于最终答案的正确性,并不能保证推理过程的正确性或逻辑的严谨性,模型可能通过错误的逻辑得出正确答案 。对定理证明任务的局限性:许多数学任务(如定理证明)不要求数值答案,而是需要严格的步骤推导和逻辑严谨性,使得基于最终答案的奖励机制不适用。缺乏内部验证能力:经过传统方法训练的LLMs缺乏验证自身证明有效性的能力,经常表现出高假阳性率(即认为错误的证明是有效的)。

DeepSeekMath-V2采用迭代的强化学习循环,交替优化证明验证器和证明生成器,以实现可自验证的数学推理。

证明验证

训练验证器

研究首先训练一个准确且忠实的LLM-based验证器,使其能够根据人类专家的标准识别证明中的问题并评分。